Geçtiğimiz günlerde dijital teknolojiler alanında en çok konuşulan haber Elon Musk’ın sunumunu gerçekleştirdiği heyecan verici implante edilebilir beyin makine ara yüzü projesi olan Neuralink lansmanıydı. Transhümanizm yani insanın fiziksel ve bilişsel yeteneklerinin arttırılması amacıyla teknolojiden faydalanılmasını öne süren yaklaşıma ulaşma hedefinde önemli bir aşama kaydedildi, fakat bu hedefe ulaşmak için önümüzde uzun bir yol var gibi duruyor.

Neuralink lansmanından kısa bir süre önce kuruluşunu Elon Musk ve Sam Altman gibi önemli isimlerin yaptığı Open AI şirketi yeni nesil yapay zeka algoritmaları GPT-3’ün (Generative Pre-trained Transformer 3, Üretken Ön İşlemeli Dönüştürücü 3) tanıtımını yaptılar.

Yeni algoritmanın çığır açıcı özelliklerinden bahsetmeden önce kısaca Open A I şirketinin geçmişini açıklamak istiyorum. Şirket kendini kar amacı gütmeyen yapay zeka araştırma şirketi olarak tanımlıyor. 2015 yılının sonlarında San Francisco merkezli olarak kurulan şirketin ana amacı insanlığa fayda sağlayabilecek yapay zeka algoritmaları üretmek ve bu amaçla patentleri ve araştırmalarını halka açık hale getirerek diğer kurum ve araştırmacılarla serbest işbirliği yapmayı hedeflemektedir. Elon Musk ve Sam Altman şirketi bir önceki

yazımda bahsettiğim yapay süper zekadan kaynaklanan varoluşsal risk endişelerinden dolayı bu şirketi kurduklarını açıklamışlardı.

Musk ve Altman şu soruyu sormuştur: “Geleceğin iyi olmasını sağlamak için yapabileceğimiz en iyi şey nedir? Aralarında oturabiliriz ya da düzenleyici gözetimi teşvik edebiliriz ya da yapay zekayı güvenli ve insanlığa yararlı bir şekilde geliştirmeye derinden önem veren insanlarla doğru yapıya katılabiliriz. Musk, “Aslında (dost) yapay zekayı ilerletmeye çalışırken her zaman bir riskin olduğunu” kabul etmiştir; Bununla birlikte, en iyi savunma “yapay zekaya sahip olabilecek birçok insanı güçlendirmektir. Herkesin yapay zeka gücü varsa, o zaman yapay zeka süper gücüne sahip olabilecek tek bir kişi veya küçük bir birey olmayacaktır.“

Musk ve Altman'ın yapay süper zekanın riskini azaltmaya çalışmasının karşı sezgisel stratejisi, herkese yapay zeka verme fikri, yapay zekanın varoluşsal riskinden endişe duyanlar arasında tartışmalıdır. Nick Bostrom Open AI’nin yaklaşımına kuşkuyla bakmaktadır: “Dünyaya kötü şeyler yapabilen bir düğmeniz varsa, bunu herkese vermek istemezsiniz.”

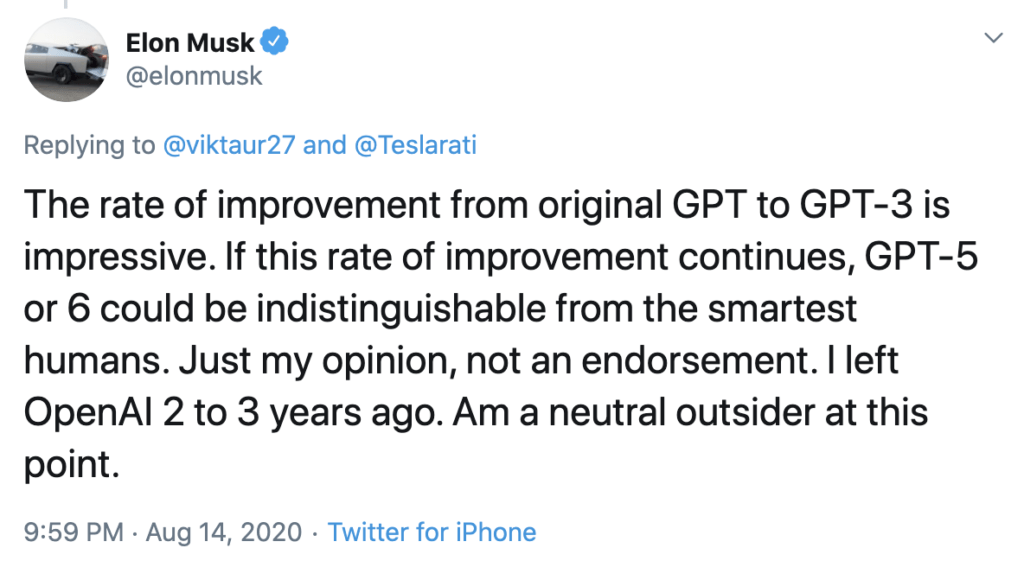

Open AI tarafından Beta sürümü yayınlanan GPT-3 algoritması ile tüm zamanların yapay zeka alanında ki en önemli sıçraması gerçekleşti. Elon Musk’ın 14 Ağustos tarihinde attığı tweet’te GPT yazılımının bu gelişme ivmesini sürdürmesi durumunda GPT-5 veya 6 algoritmasında yapay genel zeka yani insan zekası seviyesine ulaşabileceğimiz öngörüsünü yaptı.

Temel olarak doğal dil işleme mimarisini kullanan yazılımın veri işleme, veri madenciliği, veri düzenleme, veriler arası bağlantı kurma, verilerde zıtlık oluşturma, verileri anlama ve sorulara yanıt verme becerisine sahiptir.

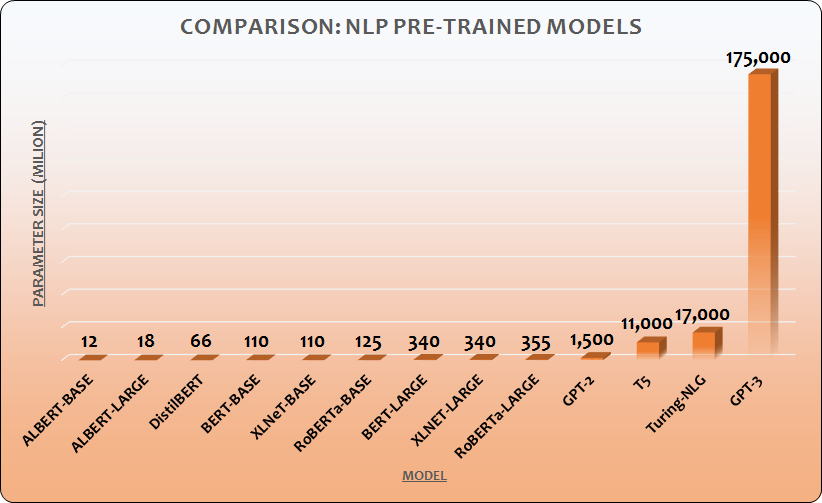

Barış Özcan'ın GPT-3 teknolojisini anlattığı videosunda çok güzel özetlediği gibi GPT-3 teknolojisi temelde arama motorlarında kullandığımız ‘Otomatik Tamamlama Aracından’ çok da farklı olmayan bir yazılım. Bir cümlenin başını verdiğinizde onu analiz edip bir kelimeden sonra hangi kelimenin gelebileceğini kestiriyor. GPT-3’ün geçen yıl yayımlanan bir önceki sürümü GPT-2’den ya da bu konudaki diğer önemli örneklerden ve tabii ki ilk önemli örnek olan 2017’deki BERT’ten en önemli farkı ve üstünlüğü kendisini eğitmek için kullandığı kaynaklar. Wikipedia’nın tamamını okumuş olduğunu tahmin etmemiz zor değil. Yapay zeka terminolojisiyle bu 3 milyar “token” anlamına geliyor. Bununla yetinmemişler 12 milyar ve 55 milyar “token”lı iki büyük kitap datasetini de eklemişler. Yani Wikipedia’nın tamamının 23 katı kadar bilgi. Büyük ihtimalle bugüne kadar yazılmış ve dijital ortama aktarılmış tüm kitapları da okutmuşlar bu yapay zekaya. GPT-3'e öğrenmesi için verilen veri kümesinin %60'ının kaynağı, 410 milyar veriden oluşan filtrelenmiş Common Crawl sürümüdür. Veri kümesinin %22'si internetteki verilerden, %16'sı şimdiye kadar yayımlanmış kitaplardan ve %3'ü Wikipedia’dan gelmektedir. 410 milyar token! Özetle tüm ansiklopedileri, kitapları ve internette yazılı her şeyi biliyor. Bunun yanında GPT-3 veriyi işleyecek 175 milyar parametreye sahiptir. Bu rakam GPT-2’de ise aslında yine çok büyük bir sayı olan 1,5 milyardı. Buradaki parametre sayısı, Nöral Ağ çalışırken aslında optimize etmeye çalıştığı değerlerin sayısı. Daha farklı bir deyişle, Yapay Zekanın öğrenme sırasında göze aldığı kıstas sayısı bu 175 Milyar. Bu sayının bu kadar büyük olması, GPT-3 ün bu kadar insansı konuşabilmesine olanak sağlayan özellik.

GPT-3 ü farklı kılan bir diğer yanı ise, herhangi bir alanda spesifik olarak çalışması için büyük bir dataset’e ihtiyaç duymuyor oluşu. GPT-3, hikaye ve şiir yazmaktan birçok farklı dilde bilgisayar kodu yazmaya; site tasarımı yapmaktan yemek tarifleri yapmaya kadar farklı alanlarda örnekler sunmaya başladı bile.

Pek çok alanda denenmeye başlayan GPT-3 algoritmasının kullanım alanları ve sağlık sektörü üzerine olası etkileri hakkında ki fikirlerimi bir sonra ki yazımda paylaşacağım.